Autopilot najpoznatijeg automobila na struju prevaren najjednostavnijim trikom

"Uz sitne modifikacije znaka za ograničenje brzine uz pomoć nalepnice, bili smo u mogućnosti da izazovemo ciljanu pogrešnu klasifikaciju"

Jedna od najvećih briga u pogledu modernih automobila je mogućnost da budu hakovani. Za razliku od vozila od pre nešto više od decenije, najnoviji automobili i kamioni brzo postaju računari na četiri točka, a Tesla je jedan od glavnih primera. To, međutim, nije nužno dobra stvar…

Nova studija koju su sproveli hakeri u "McAfee Advanced Threat Research" otkriva zabrinjavajuće stvari. Ovi hakeri uspeli su da prevare prvu generaciju Teslinih automobila sa autopilotom i da ubrzavaju od 56km/h do 136 km/h, piše CarBuzz.

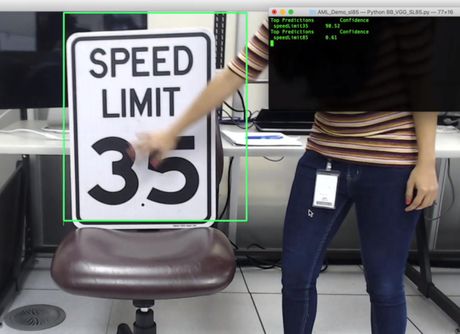

To su učinili tako što su prevarili sistem mobilnih kamera "Mobile EyeQ3" radeći nešto veoma jednostavno: promenili su saobraćajni znak za ograničenje brzine uz pomoć malo lepljive trake. Kamera je registrovala znak kao 85 milja na sat (136 km/h), a ne kao 35 (56km/h). Specifična vozila koja su testirali, Tesla Model S i Tesla Model X iz 2016. godine, odmah su povećala brzinu za 80 km/h.

To možete videti u u ovom demonstrativnom videu:

- Krajnji zaključak je da smo uspeli da postignemo prvobitni cilj. Uz sitne modifikacije znaka za ograničenje brzine uz pomoć nalepnice, bili smo u mogućnosti da izazovemo ciljanu pogrešnu klasifikaciju MobilEye kamere na Tesli i iskoristimo to da navedemo vozilo da autonomno ubrzava do 136km/h čitajući znak na kom stoji 56km/h - navedeno je na blogu laboratorije za kibernetičku sigurnost.

- Iz bezbednosnih razloga video demonstracija pokazuje da brzina počinje da raste i TACC (Traffic-Aware Cruise Control) sistem ubrzava ka 136 km/h, ali s obzirom na naše uslove testiranja, aktiviramo kočnice pre nego što dostigne ciljanu brzinu. Vredi napomenuti da je ovo naizgled jedino moguće pri prvoj primeni TACC-a, kada vozač dva puta klikne taster aktivirajući TACC. Ako sistem pogrešno registruje brzinu, autopilot se angažuje 100 odsto vremena.

"McAfee" je takođe potvrdio da je saopštio svoja otkrića i Tesl i MobilEye-u prošle godine. I jedni i dugi su "pokazali interesovanje i bili su zahvalni za istraživanje, ali nisu objavili planove za rešavanje problema na postojećoj platformi".

"Pametna" tehnologija se i dalje primenjuje, a ne uzimaju se u obzir čak i najjednostavnije stvari, koje mogu dovesti do katastrofalnih posledica.

Video: Snimak prvog ubistva čoveka od strane robota

(Telegraf.rs/V.N.)

Telegraf.rs zadržava sva prava nad sadržajem. Za preuzimanje sadržaja pogledajte uputstva na stranici Uslovi korišćenja.

Petar

To što su uradili ovi "istraživači" ne spada u istraživanje, već u grubo falsifikovanje putnih oznaka... Jer, i kod običnih znakova i automobila, neka budala može, na svoju ruku, da zameni saobraćajni znak - što je, verujem, "poteže" krivično delo.. Prema tome, "Tesla" ovde nije prevaren, nego oni koji "potez" tako tumače!!!

Podelite komentar

dg

U suštini znakovi ne bi uopšte bili neophodni ako bi se auto kretalo autopilotom po cesti čija je brzina prepoznata kroz GPS. Au omobil bi se tako sam držao ograničenja.

Podelite komentar

Akki

Tipicno americki - izbacuju na trziste nedovoljno testirane proizvode koji su ~30% nedovrseni. Imaju monopol u medijima i to znaju dobro da koriste pa ubede ljude da se radi o cudima ali u praksi - avioni im padaju, lekovi ubijaju a hrana truje. To posle u hodu peglaju (ako uspeju) ali treba preziveti njihove "inovacije".

Podelite komentar