Veselin Jevrosimović: Korisne laži

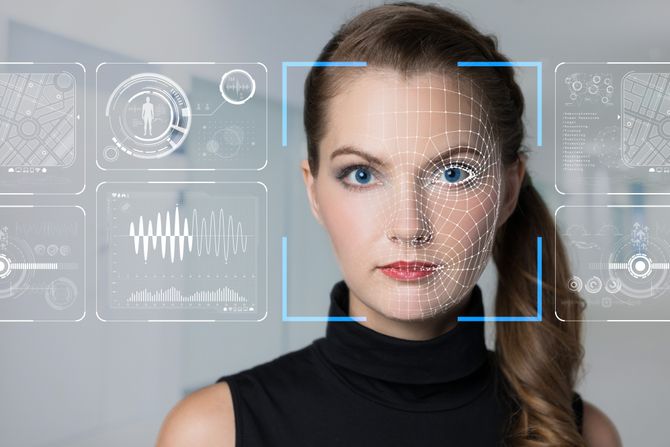

Pre nešto više od godinu dana pisao sam na ovim stranama o fenomenu nazvanom dipfejk (eng. „deepfake“).

Radi se o tehnologiji koja koristi mogućnost softvera da prepoznaje oblike, lik, glas, mimiku i pokrete tela, a zatim manipuliše fotografijama i video snimcima tako što zamenjuje aktere ili ono što oni izgovaraju na veoma veran način.

Naravno, realističnost zavisi od kvaliteta softvera i procesorske snage uređaja koji vrši izmene, pa posledice i rezultati ovakvog „igranja“ variraju od interesantne zabave do opasnog kreiranja lažnih vesti.

Upravo se u svetlu zloupotreba najviše govori i piše o dipfejk rešenjima.

Ako pogledate rezultate koje može da proizvede mobilni telefon uz neku od aplikacija za ovu namenu, jasno je sa kakvim se sve vrstama etičkih dilema i zakonodavnih problema susrećemo. Uz profesionalnu opremu i ozbiljne budžete, veoma je teško primetiti da se radi o falsifikatu.

Kako tehnologija bude napredovala, izazovi će biti sve veći. Za sve države sveta i međunarodne institucije uvođenje regulative u ovu oblast uskoro će biti jedan od najvažnijih prioriteta.

Ipak, ovoga puta bih želeo da pišem i o drugoj, lepšoj strani dipfejka.

Naime, ukoliko se budemo pridržavali osnovnih moralnih načela, poštovanja privatnosti, intelektualne svojine i prava na istinito izveštavanje, moguće su sjajne i zanimljive primene. Glumci i spikeri bi mogli da daju pravo na korišćenje njihovog glasa. Na taj način biste mogli da „angažujete“ omiljenu poznatu ličnost za svoju reklamu, edukativni video ili objavu na društvenim mrežama, bez da plaćate čitavo bogatstvo.

Drugi primer je „oživljavanje“ velikana iz prošlosti. Zamislite igrani ili dokumentarni film o istorijskim događajima u kojima bi bili korišćeni likovi i glasovi stvarnih ličnosti reprodukovani na osnovu fotografija, portreta i retkih audio zapisa.

Voleo bih da odem u muzej u kome bi poznata dela slikara bila animirana. Još jedna zgodna primena je simultano prevođenje glasom govornika, bez potrebe za učešćem prevodioca.

Kao i kod svakog drugog ljudskog dostignuća, i ovde je samo pitanje na koji način ćemo koristiti dipfejk. U rukama zlonamernika, on predstavlja opasno oružje za manipulisanje javnim mnjenjem, urušavanje ugleda i ucenjivanje pojedinaca.

Ako se potrudimo da tehnologiju upotrebljavamo na etičan i odgovoran način, onda će iz toga proisteći nove vrednosti koje mogu biti korisne za sve.

(Telegraf.rs)

Video: Sajam automoila BG Car show 2026, počinje sutra, u sredu, 18. marta

Telegraf.rs zadržava sva prava nad sadržajem. Za preuzimanje sadržaja pogledajte uputstva na stranici Uslovi korišćenja.